Если у вас уже есть Docker-контейнеры и VDS, логичный следующий шаг — оркестрация. Но как только начинаешь выбирать между Kubernetes, k3s, k0s, Nomad и Docker Swarm, сразу всплывают вопросы: что проще развернуть, что надежнее, где меньше боли с сетью и хранилищем, и главное — что реально тянуть на паре-тройке VDS без выделенного DevOps-отдела.

В этом обзоре я не буду повторять документацию. Вместо этого разберем, как эти решения ведут себя именно на виртуальных серверах: требования, типичные грабли, сценарии применения и практические рекомендации.

Отправная точка: зачем вам кластер на VDS

На одном VDS сегодня спокойно живет десяток контейнеров под управлением Docker Compose. Зачем вообще усложнять жизнь кластером?

Основные причины:

- Высокая доступность: приложению нужно переживать падение одного сервера.

- Плавные обновления: rolling / blue-green деплой без даунтайма.

- Горизонтальное масштабирование: добавили еще один VDS — получили больше ресурсов.

- Изоляция окружений: dev/stage/prod, multi-tenant SaaS, ресурсные квоты.

- Автоисцеление: перезапуск упавших контейнеров, перемещение подов/тасков.

С другой стороны, оркестратор — это:

- дополнительная сложность в сети и хранилище;

- своя кривая обучения и своя экосистема tooling;

- ресурсные накладные расходы на control plane.

Поэтому важно сразу понимать, какой оркестратор за что отвечает и где он оправдан на небольшом кластере из 2–5 VDS.

Обзор кандидатов: k3s, k0s, Nomad, Docker Swarm

Кратко напомню, о чем речь, в контексте VDS. Здесь я смотрю именно с позиции практической эксплуатации: что вы получите в бою, а не в учебном демо.

k3s: «облегченный Kubernetes» для VDS

k3s — это полностью совместимый с Kubernetes дистрибутив, оптимизированный по ресурсоемкости и простоте установки. Типичный сценарий: кластер из 3–5 VDS (2–4 vCPU, 4–8 ГБ RAM), где нужен «настоящий» Kubernetes, но без монструозной инсталляции с десятком компонентов.

Особенности на VDS:

- один бинарник, меньше зависимостей;

- control plane может жить на той же ноде, где и workload;

- есть встроенный локальный storage (local-path-provisioner), но для продакшена лучше внешний том или сетевое хранилище;

- поддержка стандартных Kubernetes-объектов, CRD, ingress-контроллеров и т.д.

Если вам важно не «как угодно», а именно Kubernetes API, k3s — почти всегда лучший старт на VDS. На старте будет полезно держать под рукой отдельную «песочницу» на небольшом VDS для теста обновлений и опасных изменений, по аналогии с тем, как это делается в подходе с резервными стендами (подробнее об этом можно почитать в материале про отдельную песочницу для восстановления из бэкапов и проверки изменений).

k0s: Kubernetes как единый бинарь

k0s идет тем же путем «минималистичного Kubernetes», но с другими инженерными решениями. Основная идея — один двоичный файл, который содержит все, что нужно для control plane и data plane.

Что важно с точки зрения эксплуатации на VDS:

- четкое разделение ролей нод (control plane, воркеры);

- конфигурация кластера через YAML-манифест, который удобно хранить в Git;

- нет «встроенных лишних вещей» — вы сами выбираете CNI, storage, ingress.

По ощущениям, k0s чуть более «чистый» и модульный, чем k3s, но требует больше ручной работы: нужно самому продумать сеть, хранилище, ingress. На маленьком VDS-кластере это одновременно плюс (контроль) и минус (лишняя оргработа).

Nomad: не только контейнеры, но и системные сервисы

Nomad — это оркестратор от HashiCorp, который оперирует понятием jobs и tasks и может запускать не только контейнеры, но и «голые» бинарники, скрипты, systemd-подобные сервисы.

Ключевые моменты на VDS:

- легкий control plane: несколько сотен МБ памяти на сервер-деймон;

- один двоичный файл для агента, минимум внешних зависимостей;

- хорошо дружит с Consul (service discovery) и Vault (секреты), но для продакшена это почти обязательные компоненты;

- ориентирован больше на backend-сервисы и batch-задачи, чем на «астрологию ингрессов и CRD».

Если вам нужны в первую очередь фоновая обработка, очереди, cron-like задачи и минимум Kubernetes-сложности, Nomad на 2–3 VDS выглядит очень убедительно.

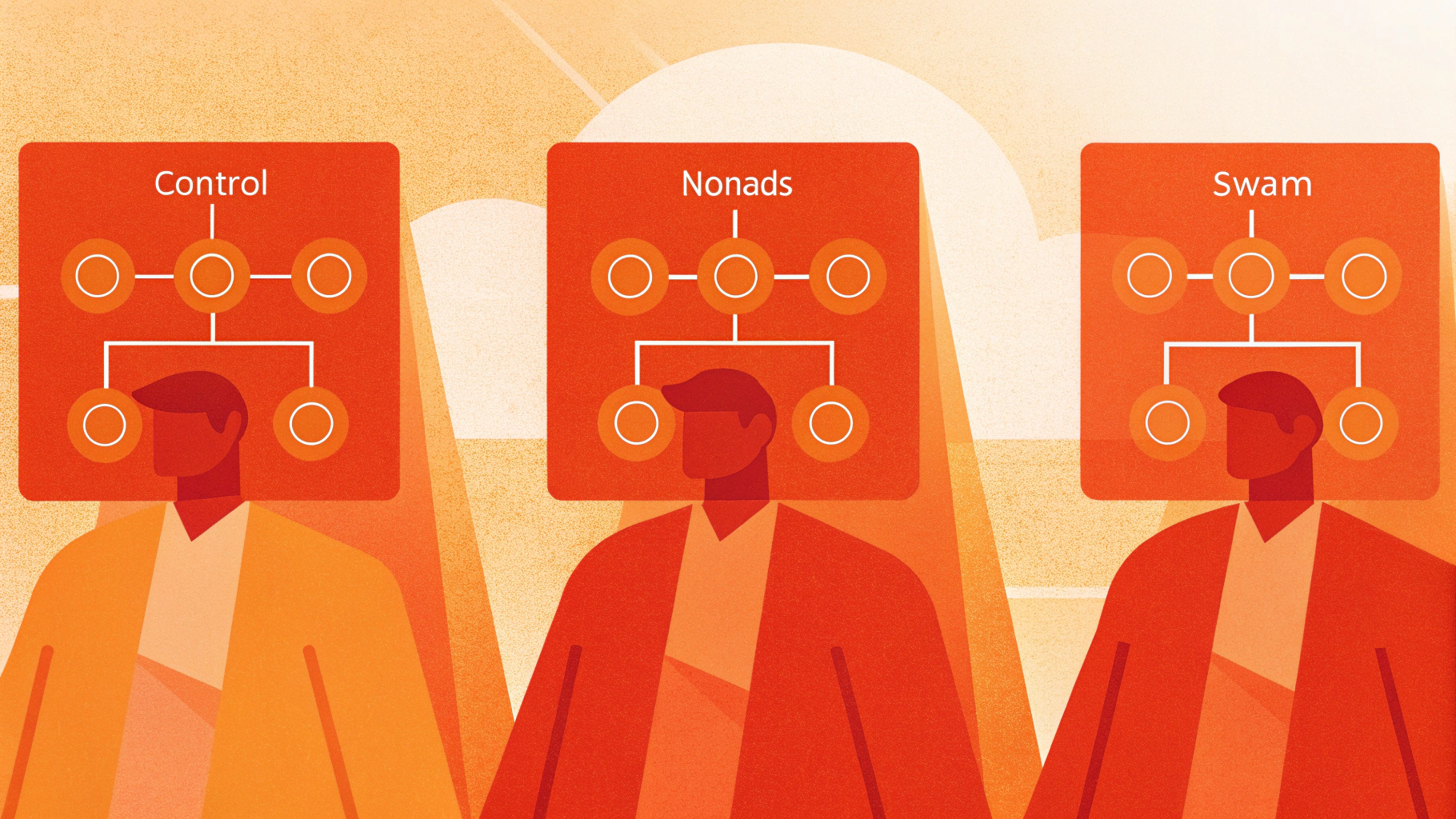

Docker Swarm: минимальный порог входа

Docker Swarm встроен в Docker и поэтому выигрывает по простоте старта. На кластере из пары VDS вы получаете:

- простую модель сервисов и реплик;

- распределенный overlay-сетевой стек без дополнительного CNI;

- минимальную конфигурацию и быстрый деплой.

Слабые стороны на VDS в 2025 году:

- проект уже давно не развивается так активно, как Kubernetes-экосистема;

- меньше tooling и интеграций (CI/CD, мониторинг, ingress и т.д.);

- меньше готовых best practices для сложных сценариев HA.

Если задача — просто «поднять 3–4 сервиса на нескольких VDS» и вы не планируете расти в полноценный Kubernetes, Docker Swarm все еще хорош. Но как долгосрочная платформа для сложной инфраструктуры он уже спорен.

Требования к VDS: CPU, RAM, диск, сеть

Любой кластер, даже «минималистичный», очень чувствителен к ресурсам. Сильно экономить на параметрах VDS можно только понимая, какие именно накладные расходы вносит ваш оркестратор и сопутствующие сервисы (ingress, мониторинг, логирование).

Control plane vs worker: как делить роли

На небольших кластерах часто совмещают роли: master и worker на одном VDS. Это нормальная практика, но:

- для k3s/k0s старайтесь иметь хотя бы 2 vCPU и 4 ГБ RAM на ноду, где живет control plane;

- для Nomad и Swarm можно жить и с 1–2 vCPU и 2–4 ГБ RAM, если нагрузка небольшая.

Оптимальная стартовая раскладка для «доморощенного» продакшена:

- 3 VDS: одна нода с приоритетом control plane + 2 воркера;

- каждая нода 2–4 vCPU, 4–8 ГБ RAM;

- диск SSD, минимум 40–60 ГБ, лучше больше (логам и Docker-слоям свойственно неожиданно расти).

При выборе тарифов удобно сначала посадить приложение на обычный виртуальный хостинг, понять примерный профиль нагрузки, а уже потом переносить в кластер на VDS.

Сеть и latency между VDS

Кластер чувствителен к задержкам и обрывам между нодами. В контексте VDS важно:

- желательно, чтобы все VDS находились в одном дата-центре и одной сети провайдера;

- стабильный ping (десятки мс максимум, лучше единицы);

- отдельная приватная сеть между VDS (VXLAN/overlay используют ее как подложку).

Периодические «микрообрывы» связи между серверами приводят к флаппингу нод, пересозданию подов/тасков и странным проблемам с балансировкой. На этапе выбора VDS-локации лучше сразу проверить сети простыми продолжительными ping/iperf-тестами.

Сеть в кластере: CNI, overlay, ingress

Сеть — одна из ключевых зон неоднозначности при выборе между Kubernetes, Nomad и Swarm. Ошибки здесь обычно выстреливают под нагрузкой или при частичных сбоях.

k3s и k0s: выбор CNI

Оба решения поддерживают стандартные CNI-плагины. На VDS-кластерах наиболее популярны:

- Flannel: прост, подходит для небольших кластеров, минимум настроек;

- Calico: мощный, с сетевыми политиками, но чуть тяжелее и сложнее;

- Cilium: eBPF, продвинутые функции, но требует хорошего понимания ядра и сети.

Для 2–5 VDS с обычными веб-приложениями я бы стартовал с Flannel или Calico в упрощенной конфигурации. Cilium имеет смысл, если вы планируете микросервисный зоопарк с агрессивной сегментацией и deep observability, либо готовы детально разбираться в сетевой части (про изоляцию контейнеров на уровне ядра можно посмотреть также материал про безопасность контейнеров на gVisor и Firecracker).

Ingress и балансировка трафика

На VDS у вас, как правило, есть ограниченный пул внешних IP. Типовой паттерн:

- один или два узла выставлены наружу (публичный IP, 80/443);

- на них ставится ingress-контроллер (Nginx, HAProxy, Traefik) или load balancer Nomad/Swarm;

- внутри кластера используются сервисы типа ClusterIP.

На Kubernetes (k3s/k0s) это обычно решается ingress-контроллером. На Nomad — через встроенный сервисный роутинг (с Consul), либо внешний балансировщик. В Docker Swarm — через published-порты и встроенный ingress-роутинг.

Критично заранее продумать:

- где будет единственная точка входа для HTTP(S);

- как вы будете обновлять сертификаты TLS (покупные SSL-сертификаты или автоматизация через ACME);

- как будете прокидывать WebSocket, gRPC и долгие соединения.

Хранилище: persistent volume в мире VDS

На bare-metal-кластере вы можете построить Ceph/Longhorn и получить распределенное блочное хранилище. На небольшом VDS-кластере это чаще всего оверкилл и лишняя точка отказа, особенно если команда маленькая.

Типичные подходы:

- Локальные тома на каждой VDS для stateful-сервисов, которые не требуют HA (тестовые БД, кэши);

- Выделенный VDS с БД, к которому из кластера ходят по сети (PostgreSQL/MySQL на отдельном сервере);

- Объектное хранилище для статики и файлов (S3-совместимое или аналог).

На маленьких кластерах разумнее избегать сложных распределенных файловых систем и кластерных БД внутри оркестратора. База на отдельном VDS с продуманными бэкапами обычно дает больше предсказуемости и проще в сопровождении.

Сравнение по типовым сценариям

Перейдем от абстракций к практическим кейсам. Рассмотрим четыре оркестратора в контексте типичных задач, с которыми ко мне чаще всего приходят владельцы проектов на VDS.

Небольшое веб-приложение + фоновые задачи

Условие: 2–3 VDS, пара PHP/Node.js-сервисов, очереди, воркеры, простая БД на отдельном сервере.

- k3s: хорошо ложится, если вы уже знакомы с Kubernetes или хотите учиться именно ему. Из коробки ingress, Deployments, CronJobs — удобно.

- k0s: потребует больше ручной настройки, но даст чистую Kubernetes-базу под вашу инфраструктуру.

- Nomad: отличный вариант, если не хотите вникать в YAML Kubernetes, а предпочитаете более прямолинейные job-описания и batch-ориентацию.

- Docker Swarm: победитель по времени поднятия до MVP. Пара команд — и сервисы разворачиваются. Но нужно понимание, что это тупиковая ветка эволюции.

Микросервисный backend с десятками сервисов

Условие: 5+ сервисов, отдельные команды, CI/CD, требования по observability и политике доступа.

- k3s/k0s: де-факто стандарт. Нужны Namespace, RBAC, NetworkPolicy, sidecar-паттерны, сервисная сетка. Kubernetes-экосистема тут выигрывает.

- Nomad: можно, особенно в сочетании с Consul и Vault, но tooling и количество «рецептов» меньше.

- Docker Swarm: быстро упретесь в ограничения модели, особенно по observability и сложным routing-сценариям.

Batch/cron-задачи, очереди, воркеры

Условие: много периодических и фоновых задач, часть с тяжелой CPU/IO-нагрузкой, важно гибко управлять очередями.

- Nomad: создан для этого. Job-тип batch, системные таски, понятная модель ресурсных ограничений.

- k3s/k0s: CronJob, Job, HPA — все это решает задачу, но конфигурация сложнее, особенно если нужен динамический контроль нагрузки.

- Swarm: может, но tooling для сложных cron/queue-паттернов сильно уступает.

Dev/stage окружения на одном кластере

Условие: один кластер на 3–4 VDS, в нем dev, test и staging, изоляция по ресурсам и доступам.

- k3s/k0s: Namespaces, ResourceQuota, LimitRange, отдельные ingress-правила — удобно вести несколько окружений на одном кластере.

- Nomad: есть namespaces и ACL, но инструментов и best practices меньше.

- Swarm: изоляцию приходится выдумывать самому (отдельные стеки, сети, имена сервисов).

Надежность и обновления на VDS-кластере

Любой оркестратор придется обновлять, а VDS как среда добавляет свои нюансы: перезагрузки хостов, переезды на другие гипервизоры, плановые работы провайдера. Важно не только выбрать дистрибутив, но и продумать процедуру его обновления.

Размещение control plane

Для небольших кластеров часто достаточно одного полноценного control plane с бэкапами (Kubernetes etcd / Nomad Raft-снапшоты). Но лучше:

- иметь минимум 3 ноды, на которых может жить control plane (пусть и не всегда все активны);

- выделить хотя бы одну VDS, на которой минимизируете количество тяжелых workload;

- регулярно проверять бэкапы конфигурации кластера (и уметь восстанавливать их на тесте).

Обновления оркестратора

Стратегии:

- Kubernetes (k3s/k0s): читать release notes, обновляться минорными версиями по очереди, держать совместимость версий control plane и node-компонента.

- Nomad: rolling-обновление агентов, backward-совместимость обычно хорошая, но стоит внимательно смотреть на изменения в job-формате.

- Swarm: обновляете Docker Engine по нодам, но учитывайте, что поддержка старых Swarm-фич может меняться.

Всегда тестируйте обновление кластера на «песочнице» (отдельные маленькие VDS), а не на боевом окружении. И не забывайте про базовую гигиену: мониторинг нагрузки, алерты на деградацию сети, логирование инцидентов.

Нагрузка на оператора: что проще администрировать

Большой вопрос: что будет проще сопровождать одному-двум администраторам без целого отдела SRE. Здесь важно смотреть не только на сам оркестратор, но и на «обязательный минимум» сопутствующих сервисов.

Kubernetes (k3s/k0s)

Плюсы:

- богатая экосистема: Helm, ArgoCD, Prometheus-операторы, ingress- и CSI-драйверы;

- множество готовых статей, гайдов, best practices именно под VDS;

- универсальность: почти любая задача уже кем-то решена.

Минусы:

- крутая кривая обучения: много абстракций и движущихся частей;

- легко превратить кластер в «зоопарк CRD и операторов»;

- диагностика сетевых и storage-проблем требует достаточно глубокого понимания.

Nomad

Плюсы:

- более простая ментальная модель: есть кластеры, jobs, allocations — без перегибов;

- один бинарь, минимальная зависимость от внешних сервисов (если не тянуть весь стек HashiCorp);

- отлично подходит, если много batch-задач и немного веб-приложений.

Минусы:

- меньше «рецептов из интернета» под вашу конкретную задачу;

- меньше интеграций «из коробки» (но базовый мониторинг и алертинг настраиваются без боли);

- если вы будете расти в сторону сложной микросервисной архитектуры, может понадобиться миграция на Kubernetes.

Docker Swarm

Плюсы:

- минимум нового: все почти как Docker Compose, только с репликами и несколькими хостами;

- быстрый старт и простой деплой.

Минусы:

- стагнация развития: экосистема и документация не растут так же активно;

- для сложных сценариев приходится колхозить поверх, а не использовать стандартные механизмы;

- риски в долгосрочной перспективе: все больше tooling ориентировано на Kubernetes.

Рекомендации по выбору: что выбрать для VDS сегодня

Сведем все в несколько практических рекомендаций «на 2025 год» для кластеров на VDS. Это не догма, но хорошая отправная точка для большинства типичных проектов.

Когда выбрать k3s

Выбирайте k3s, если:

- вам нужен именно Kubernetes API и вы хотите быть совместимыми с «большим» Kubernetes;

- у вас 2–5 VDS и вы готовы немного потратить время на изучение базовых концепций;

- вы планируете использовать Helm-чарты, готовые операторы и стандартные инструменты мониторинга.

k3s — хороший баланс между «настоящим Kubernetes» и адекватной сложностью для небольших кластеров.

Когда выбрать k0s

k0s подходит, если:

- вам нужна более «чистая» Kubernetes-инсталляция с полным контролем над компонентами;

- вы планируете описывать кластер как код через единый конфигурационный YAML;

- вы не боитесь руками выбирать CNI, storage и ingress-слой.

k0s особенно приятен, если вы строите GitOps-подход к управлению самим кластером (а не только приложениями).

Когда выбрать Nomad

Nomad — отличный выбор, если:

- ваши задачи — это в основном batch-обработка, очереди, cron-задачи и фоновые сервисы;

- вы цените простую модель и не хотите разбираться с множеством Kubernetes-примитивов;

- у вас уже есть или планируется стек HashiCorp (Consul, Vault).

На 2–3 VDS с кучей фоновых задач Nomad часто оказывается менее нервозным решением, чем Kubernetes.

Когда (еще) можно жить на Docker Swarm

Swarm имеет смысл, если:

- вам нужно очень быстро и просто развернуть несколько контейнерных сервисов на 2–3 VDS;

- у вас нет требований по сложной observability и fine-grained-политикам безопасности;

- вы готовы принять риск, что через пару лет придется мигрировать на Kubernetes или что-то еще.

Для долгосрочной инфраструктуры с ростом нагрузки и команды я бы все же смотрел в сторону k3s/k0s или Nomad.

Итог

Оркестратор на VDS — это уже не экзотика, а нормальная практика для проектов, которые переросли один сервер и docker-compose. При этом у вас есть выбор: от Kubernetes-дистрибутивов (k3s, k0s) до альтернативных решений вроде Nomad и по-прежнему живого Docker Swarm.

Если вам нужен «универсальный язык» инфраструктуры и доступ ко всей экосистеме — ставьте k3s или k0s и закладывайте время на обучение. Если задача — надежно и просто гонять воркеры и batch-задачи — смело смотрите на Nomad. Если же вам нужен быстрый запуск пары сервисов на нескольких VDS и вы понимаете ограничения — Swarm по-прежнему свое отрабатывает.

Главное — не увлекаться сложностью ради сложности. Оцените свои реальные потребности, компетенции команды и горизонты роста проекта, и под это подберите оркестратор. Тогда и кластер на VDS будет работать предсказуемо, а не жить своей загадочной жизнью.